💰Czy drogę do Superinteligencji da się wykupić?

➕ 🤖 AI w praktyce: Rozmowa z CEO TextUnited czyli jak AI wspiera jakość tłumaczeń.

🔉Wolisz wersję audio? Nie możesz przeczytać teraz maila?

Przesłuchaj tutaj

🎯W DZISIEJSZYM WYDANIU

🎓 AI od zera do zrozumienia: Czy drogę do Superinteligencji da się wykupić?

🤖 AI w praktyce: Jak AI wspiera automatyzację i jakość tłumaczeń w TextUnited? Marek Piórkowski opowiada o wyzwaniach, innowacjach i przyszłości branży tłumaczeniowej.

🥡 AI na Wynos:

Czy sztuczna inteligencja zagraża muzykom?

Test okularów AI. Jak działają Brilliant Labs?

Nowe modele od Meta - Llama 3.2 1B, 3B, 11B i 90B.

OpenAI planuje przekształcenie swojej struktury w korporację nastawioną na zysk.

CTO OpenAI - Mira Murati opuszcza OpenAI.

Córka Donalda Trumpa - Ivanka Trump zachęca do świadomości sytuacyjnej odnośnie tego co się dzieje wokół AI i już nie tak odległej Generalnej Sztucznej Inteligencji (AGI).

📚 Rekomendowana Biblioteka:

The Age of AI: And Our Human Future - książka - autor: Henry Kissinger, Eric Schmidt, Daniel Huttenlocher.

Czy moc obliczeniowa jest kluczem do sukcesu?

W ostatnich miesiącach byliśmy świadkami bezprecedensowych inwestycji w moc obliczeniową w sektorze AI. Firmy technologiczne prześcigają się w budowie coraz potężniejszych centrów danych, inwestując kwoty, które mogłyby sfinansować badania nad lekarstwami na choroby trapiące ludzkość od wieków lub pokryć roczne budżety średniej wielkości państw. Microsoft eksperymentował z budową centrów danych pod wodą, a startup Lumen Orbit planuje umieścić je w kosmosie. Elon Musk ogłosił, że jego zespół xAI uruchomił klaster treningowy Colossus, składający się ze 100 000 jednostek H100, w zaledwie 122 dni.

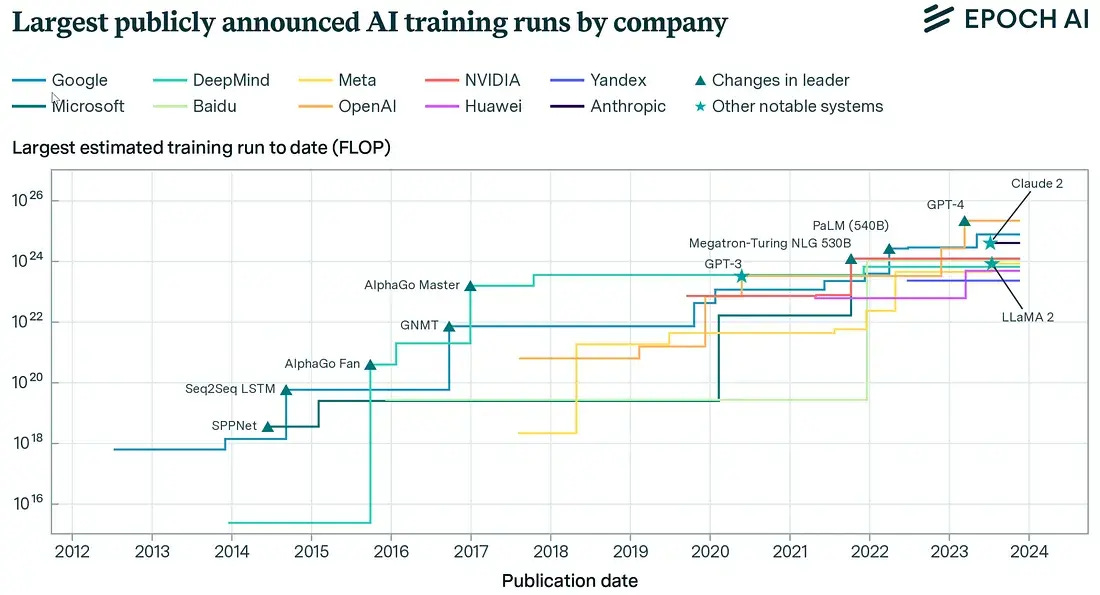

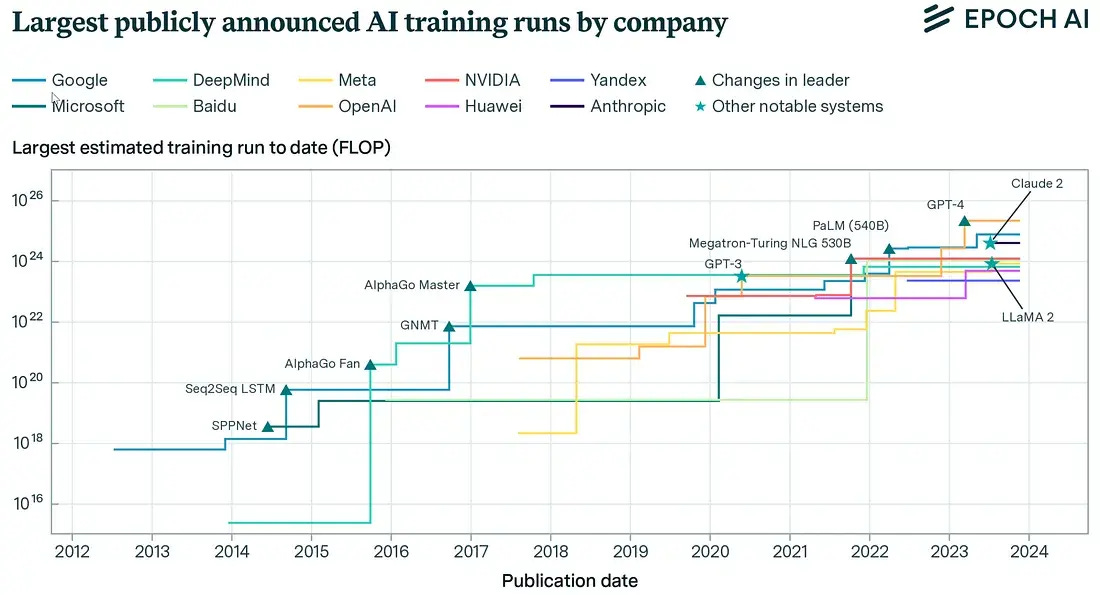

Skala tych inwestycji jest oszałamiająca. Według danych Epoch AI, w ciągu ostatnich 11 lat Google zwiększył swoją moc obliczeniową 10 milionów razy, podczas gdy OpenAI i Meta osiągnęły milionkrotny wzrost w zaledwie 6 lat. Te liczby skłaniają do fundamentalnego pytania: czy możemy dosłownie "kupić sobie drogę" do superinteligencji?

Zmiana krajobrazu AI

W ciągu ostatnich kilku lat krajobraz AI uległ dramatycznym zmianom. Google nie jest już niekwestionowanym liderem, a OpenAI, wspierane przez Microsoft, rzuca wyzwanie gigantom swoim modelem GPT-4. Anthropic, z modelem Claude 3.5, jest silnym nowicjuszem, podczas gdy Meta pozostaje znaczącym graczem, szczególnie z najnowszym Llama 3.1 pod względem surowej skali obliczeniowej.

Mark Zuckerberg, w niedawnym wywiadzie, trafnie ujął obecną sytuację:

"Planowanie w kontekście krzywej wykładniczej jest jedną z najtrudniejszych rzeczy na świecie: jak długo będzie się ona utrzymywać? Uważam, że jest wystarczająco prawdopodobne, że będzie się ona utrzymywać, by warto było zainwestować dziesiątki lub setki miliardów w budowę infrastruktury, zakładając, że jeśli to się utrzyma, otrzymamy naprawdę niesamowite rzeczy, które stworzą niesamowite produkty. Ale nie sądzę, żeby ktokolwiek w branży mógł powiedzieć na pewno, że będzie się to skalować w tym tempie."

Gigantyczne inwestycje w centra danych

Skala inwestycji w infrastrukturę AI jest bezprecedensowa. Według The Information, dwie oddzielne firmy zgłosiły się do Josha Teigena, Komisarza Handlu, oraz gubernatora Dakoty Północnej z propozycją budowy mega centrów danych AI, każde o wartości 125 miliardów dolarów. Te centra początkowo miałyby zużywać od 500 megawatów do 1 gigawata mocy, z planami zwiększenia do 5 lub 10 gigawatów w ciągu kilku lat.

Aby lepiej zrozumieć skalę tych liczb, warto spojrzeć na diagram Epoch AI (Załącznik 1). Pokazuje on, że przy mocy obliczeniowej rzędu 3e31 FLOP (co odpowiada 1 000 000 razy większej mocy niż GPT-4), głównym ograniczeniem staje się tzw. "ściana opóźnień" (latency wall). To sugeruje, że nawet przy ogromnych inwestycjach w moc obliczeniową, fizyczne ograniczenia, takie jak opóźnienia w przesyłaniu danych, mogą stanowić barierę dla dalszego skalowania.

Prawo Amdahla i jego implikacje

W kontekście skalowania mocy obliczeniowej kluczowe znaczenie ma prawo Amdahla. Zgodnie z tym prawem, linie reprezentujące wyższe porcje równoległe (95%, 75%, 50%) pokazują początkowo większe przyspieszenie, ale osiągają plateau wcześniej niż te z niższymi porcjami równoległymi. Oznacza to, że bez względu na liczbę dodanych GPU, maksymalne teoretyczne przyspieszenie jest ograniczone przez wąskie gardło sekwencyjne.

To prawo ma istotne implikacje dla firm inwestujących w ogromne klastry obliczeniowe. Sugeruje ono, że samo zwiększanie liczby procesorów może nie przynieść oczekiwanych rezultatów, szczególnie w przypadku zadań, które nie dają się łatwo zrównoleglić.

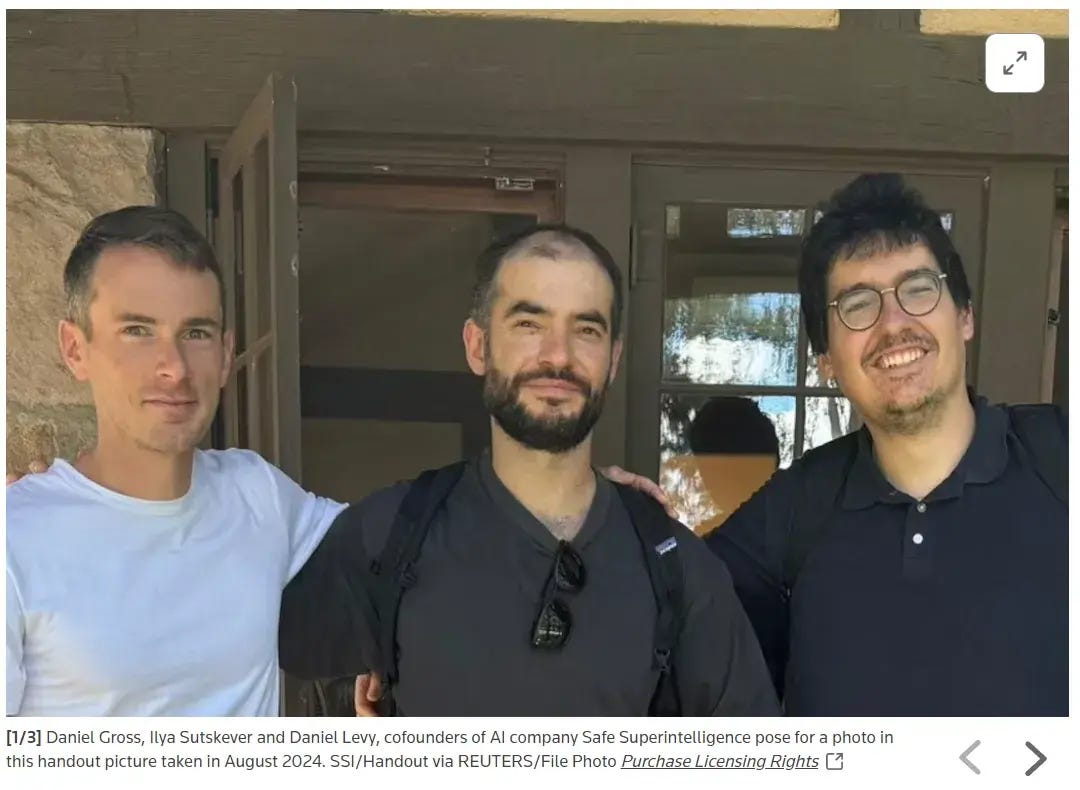

Nowe podejście do skalowania: Safe Superintelligence

W tym kontekście warto zwrócić uwagę na nowe inicjatywy, które próbują podejść do problemu skalowania AI w inny sposób. Jedną z nich jest startup Safe Superintelligence, założony przez Ilyę Sutskevera, byłego głównego naukowca OpenAI. Firma ta niedawno pozyskała 1 miliard dolarów przy wycenie 5 miliardów dolarów, co świadczy o ogromnym zainteresowaniu inwestorów.

Co ciekawe, Sutskever sugeruje, że jego firma podejdzie do skalowania inaczej niż jego były pracodawca, OpenAI. W artykule opublikowanym przez Reuters, Sutskever stwierdził:

"Wszyscy mówią tylko o hipotezie skalowania. Nikt nie zadaje pytania, co właściwie skalujemy."

Dodał również:

"Niektórzy ludzie mogą pracować naprawdę długie godziny i po prostu szybciej podążać tą samą ścieżką. To nie jest nasz styl. Ale jeśli zrobisz coś innego, wtedy możliwe staje się stworzenie czegoś wyjątkowego."

Te wypowiedzi sugerują, że Safe Superintelligence może skupić się na jakościowych aspektach rozwoju AI, a nie tylko na zwiększaniu mocy obliczeniowej.

Rywalizacja o moc obliczeniową

Mimo to, wyścig o dominację w mocy obliczeniowej trwa. Elon Musk, za pośrednictwem swojej firmy xAI, twierdzi, że wkrótce będzie dysponował około 200 000 jednostek równoważnych H100 - najnowszych GPU od Nvidii. Te ambitne plany budzą niepokój u konkurencji. Sam Altman, CEO OpenAI, wyraził w rozmowach z kierownictwem Microsoftu obawy, że xAI może wkrótce mieć dostęp do większej mocy obliczeniowej niż OpenAI.

Jednak raport z The Information rzuca światło na tę sytuację. Według doniesień, klaster 100 000 chipów Muska, znany jako Colossus, nie jest jeszcze w pełni operacyjny. Mniej niż połowa tych chipów jest obecnie w użyciu, głównie z powodu ograniczeń związanych z zasilaniem i infrastrukturą sieciową.

Nowe modele AI: o1-preview (Strawberry)

W tym wyścigu o moc obliczeniową, kluczowe znaczenie mają również postępy w rozwoju modeli AI. Niedawno OpenAI zaprezentowało model o1-preview, znany wcześniej jako "Strawberry". Model ten znacząco przewyższa swojego poprzednika, GPT-4, w zadaniach wymagających złożonego rozumowania.

O1-preview wykorzystuje algorytm uczenia ze wzmocnieniem na dużą skalę, który uczy go produktywnego myślenia z wykorzystaniem łańcucha rozumowania (chain of thought). Rezultaty są imponujące: w USA Math Olympiad (AIME), o1 osiągnął wynik plasujący go wśród 500 najlepszych uczniów w kraju, co stanowi ogromny skok w porównaniu z GPT-4, który osiągał jedynie 12% skuteczności. Ponadto, o1 przewyższa dokładność ludzi z tytułem doktora w testach z fizyki, biologii i chemii (benchmark GPQA Diamond).

Jakub szerzej analizował możliwości modelu o1-preview w swoim artykule na naszej stronie.

Wyzwania techniczne i ograniczenia skalowania

Mimo imponujących postępów, skalowanie mocy obliczeniowej napotyka na istotne wyzwania techniczne. Jednym z głównych problemów jest opóźnienie w komunikacji między rozproszonymi systemami obliczeniowymi. Nawet przy prędkości światła w światłowodzie (208 188 km/s), czas podróży w obie strony (RTT) między wschodnim a zachodnim wybrzeżem USA wynosi 43,2 milisekundy. To opóźnienie, wraz z dodatkowymi opóźnieniami wprowadzanymi przez urządzenia telekomunikacyjne, stanowi znaczące wyzwanie dla standardowego treningu synchronicznego.

Ponadto, zwiększanie mocy obliczeniowej wiąże się z ogromnymi kosztami energetycznymi. Firmy takie jak Google, Microsoft i Amazon zobowiązały się do osiągnięcia neutralności węglowej do 2030 roku. Jednak rosnące zapotrzebowanie na moc obliczeniową do trenowania zaawansowanych modeli AI może stanowić zagrożenie dla realizacji tych celów.

Perspektywy na przyszłość

Analizując obecną sytuację, możemy zauważyć, że wyścig o dominację w dziedzinie AI poprzez zwiększanie mocy obliczeniowej stawia przed nami fascynujące, ale i trudne wyzwania technologiczne i etyczne.

Diagram Epoch AI (Załącznik 2) przedstawia największe publicznie ogłoszone treningu AI według firm. Widać na nim wyraźnie, jak w ciągu ostatnich lat nastąpił gwałtowny wzrost mocy obliczeniowej wykorzystywanej do trenowania modeli AI, z GPT-4 i Claude 2 na czele tego wyścigu.

Czy samo zwiększanie mocy obliczeniowej wystarczy do stworzenia prawdziwej sztucznej inteligencji, czy potrzebujemy fundamentalnych przełomów konceptualnych? Odpowiedź na to pytanie ukształtuje przyszłość AI i może mieć głębokie implikacje dla całego sektora technologicznego i gospodarki globalnej.

Wnioski

Wyścig o superinteligencję poprzez skalowanie mocy obliczeniowej jest fascynującym zjawiskiem, które może przynieść przełomowe odkrycia w dziedzinie AI. Jednocześnie stawia on przed nami poważne wyzwania techniczne, etyczne i środowiskowe.

Kluczowe będzie znalezienie równowagi między ambicjami technologicznymi a odpowiedzialnym rozwojem. Firmy, które skupią się nie tylko na zwiększaniu mocy obliczeniowej, ale także na innowacyjnych podejściach do architektury AI i efektywności energetycznej, mogą mieć największe szanse na sukces w długoterminowej perspektywie.

W najbliższych miesiącach i latach będziemy dla was uważnie śledzić rozwój sytuacji, analizując nie tylko postępy technologiczne, ale także ich wpływ na rynek, środowisko i społeczeństwo. Jedno jest pewne - jesteśmy świadkami jednego z najbardziej fascynujących wyścigów technologicznych w historii, którego wyniki mogą fundamentalnie zmienić naszą rzeczywistość.

Inspiracją dla mnie do tego artykułu był obszerny tekst Fazmina N. na Medium, który dogłębnie analizuje te zagadnienia. Zachęcam do zapoznania się z oryginalnym artykułem i śledzenia autora na Medium, gdzie znajdziecie więcej fascynujących analiz dotyczących przyszłości AI.

Autor: Fazmin N. Artykuł na Medium: https://ai.gopubby.com/the-race-for-superintelligence-scaling-challenges-and-future-prospects-f346d52698f1

Jak AI wspiera automatyzację i jakość tłumaczeń w TextUnited? Marek Piórkowski opowiada o wyzwaniach, innowacjach i przyszłości branży tłumaczeniowej.

Zajrzyj do wywiadu, aby odkryć, jak AI zmienia świat tłumaczeń na lepsze i jak możesz z tego skorzystać. To nie tylko historia sukcesu TextUnited, ale Twój poradnik do tego jak wykorzystać technologię dla maksymalnej efektywności.

Marek Piórkowski, CEO TextUnited, odkrywa przed nami kulisy rozwiązań AI, które rewolucjonizują branżę tłumaczeń. Dowiedz się, jak firmy na całym świecie optymalizują swoje procesy tłumaczeniowe, automatyzując zadania, które kiedyś były czasochłonne i kosztowne.

Kliknij w obrazek poniżej, aby przeczytać całość 👇

Od 22 października do 24 października 2024 roku odbędzie się XVIII edycja konferencji: I ❤️Marketing&Technology! Konferencja potrwa aż trzy dni, ale nas rzecz jasna interesują najbardziej dwa wydarzenia podczas tego eventu:

Konferencja I ❤️ AI, która będzie wisienką na torcie wydarzenia w warszawskich Złotych Tarasach (czwartek 24.10.2024) - TUTAJ SZCZEGÓŁY

Szkolenie AI dla marketingu, które będzie stanowić preludium do imprezy (poniedziałek 21.10.2024) - TUTAJ SZCZEGÓŁY

Horyzont.ai współpracuje ze sprawnymarketing.pl przy okazji promocji wydarzenia

🥡AI na Wynos

➡️ Czy sztuczna inteligencja zagraża muzykom? - posłuchaj audycji, w której Krzysztof Pietras odpowiada na to pytanie.

➡️ Test okularów AI. Jak działają Brilliant Labs? - obejrzyj tutaj

➡️ Nowe modele od Meta - Llama 3.2 1B, 3B, 11B i 90B. - więcej tutaj

Ciekawostka: Dzięki regulacjom 🇪🇺 nie można pobrać wielomodalnych modeli 11B i 70B między innymi w Polsce, można ich używać przez zewnętrzne aplikacje, np. Groq/Poe/Abacus. Modele te nie są również dobrze nauczone na kulturach i językach krajów europejskich.

➡️ OpenAI planuje przekształcenie swojej struktury w korporację nastawioną na zysk, co po raz pierwszy da CEO Samowi Altmanowi udziały, wywołując zmiany na kluczowych stanowiskach i potencjalnie zwiększając wartość firmy do 150 miliardów dolarów. - przeczytaj więcej

➡️ CTO OpenAI - Mira Murati opuszcza OpenAI. Przyczyny są nieznane i jak sama mówi "chcę opuścić firmę by znaleźć czas i miejsce dla własnych eksploracji”. - przeczytaj list do pracowników OpenAI Miry

➡️ Córka Donalda Trumpa - Ivanka Trump zachęca do świadomości sytuacyjnej odnośnie tego co się dzieje wokół AI i, już nie tak odległej Generalnej Sztucznej Inteligencji - przeczytaj post Ivanki i list byłego pracownika OpenAI, który udostępniła

The Age of AI: And Our Human Future - książka - autor: Henry Kissinger, Eric Schmidt, Daniel Huttenlocher.

o fascynująca analiza wpływu sztucznej inteligencji na globalne stosunki, bezpieczeństwo narodowe i strukturę społeczeństwa. Autorzy, łącząc unikalne perspektywy z dziedziny polityki, technologii i akademii, oferują głębokie spojrzenie na to, jak AI zmienia świat i jakie wyzwania stawia przed ludzkością. Książka ta rzuca światło na geopolityczne i społeczne implikacje wyścigu technologicznego w dziedzinie AI, wykraczając poza aspekty czysto techniczne. To niezbędna lektura dla wszystkich zainteresowanych przyszłością technologii i jej globalnym znaczeniem.

Jeśli masz jakieś ekscytujące pomysły lub projekty, śmiało się z nami skontaktuj, odpowiadając na ten email lub śledząc nas na X: @JakubNorkiewicz @oskar_korszen