🇵🇱 Dziś nie o AI.

Jak bronić się przed dezinformacją online

🔉Wolisz wersję audio? Nie możesz przeczytać teraz maila?

Przesłuchaj tutaj

Możesz nas słuchać także na Apple Podcast i Spotify.

🎯 W DZISIEJSZYM WYDANIU

🎓 AI od zera do zrozumienia: Dziś nie o AI. O dronach nad Polską, wojnie informacyjnej i tym, jak Kreml sieje chaos w naszych głowach.

🛠 AI w praktyce: Obrona przed dezinformacją – praktyczny checklist, który możesz zastosować od razu.

🥡 AI na Wynos:

🧩 OpenAI + Microsoft: wielka przebudowa

🤝 OpenAI × Oracle: kontrakt na chmury

💸 Podział przychodów: mniej dla partnerów

🧠 Anthropic dodaje pamięć dla zespołów

🚀 NVIDIA: nowe układy „na wideo i kod”

🏭 „AI factories” według NVIDII

🇪🇺 EU AI Act: nowe etapy obowiązywania

📈 Anthropic domyka gigantyczną rundę📚 Rekomendowana Biblioteka:

,,Trolle Putina’’ – Jessikka Aro – kulisy rosyjskich farm trolli i wojny informacyjnej.

,,Inside a Russian Troll Factory’’ – NBC News – wideo-reportaż z wewnątrz fabryki kłamstwa w Petersburgu.

Dziś nie o AI, a jednak... trochę właśnie o niej. Bo algorytmy, boty, farmy trolli i generatywne narzędzia do tworzenia treści to nowi żołnierze tej wojny. Nie stoją w okopach, nie latają w powietrzu, ale walczą w naszych telefonach i na naszych feedach.

To, co wydarzyło się w nocy z 8 na 9 września, to sam w sobie fakt o ogromnym ciężarze, ale to, co zobaczyłem w reakcjach ludzi wokół – to coś, czego nie mogłem pozostawić bez komentarza.

To nie był test jedynie dla polskiej obrony powietrznej, ale i dla naszej odporności jako społeczeństwa na manipulację. I obawiam się, że w tej drugiej części egzaminu nie wypadliśmy najlepiej.

Nie jestem ekspertem od obronności i nie udaję, że znam odpowiedzi na wszystkie pytania o bezpieczeństwo Polski. Od analizy tego, jak działają systemy OPL, są mądre głowy, sztaby i oficjalne komunikaty rządowe – do których wszystkich was odsyłam.

Wiem natomiast jedno: jeśli przestaniemy ufać sobie nawzajem, jeśli damy się rozgrywać prostymi narracjami i emocjonalnymi manipulacjami, to nawet najlepsze systemy obrony powietrznej nam nie pomogą. Bo ta wojna toczy się nie tylko o granice naszego terytorium. Ona toczy się o granice naszej świadomości.

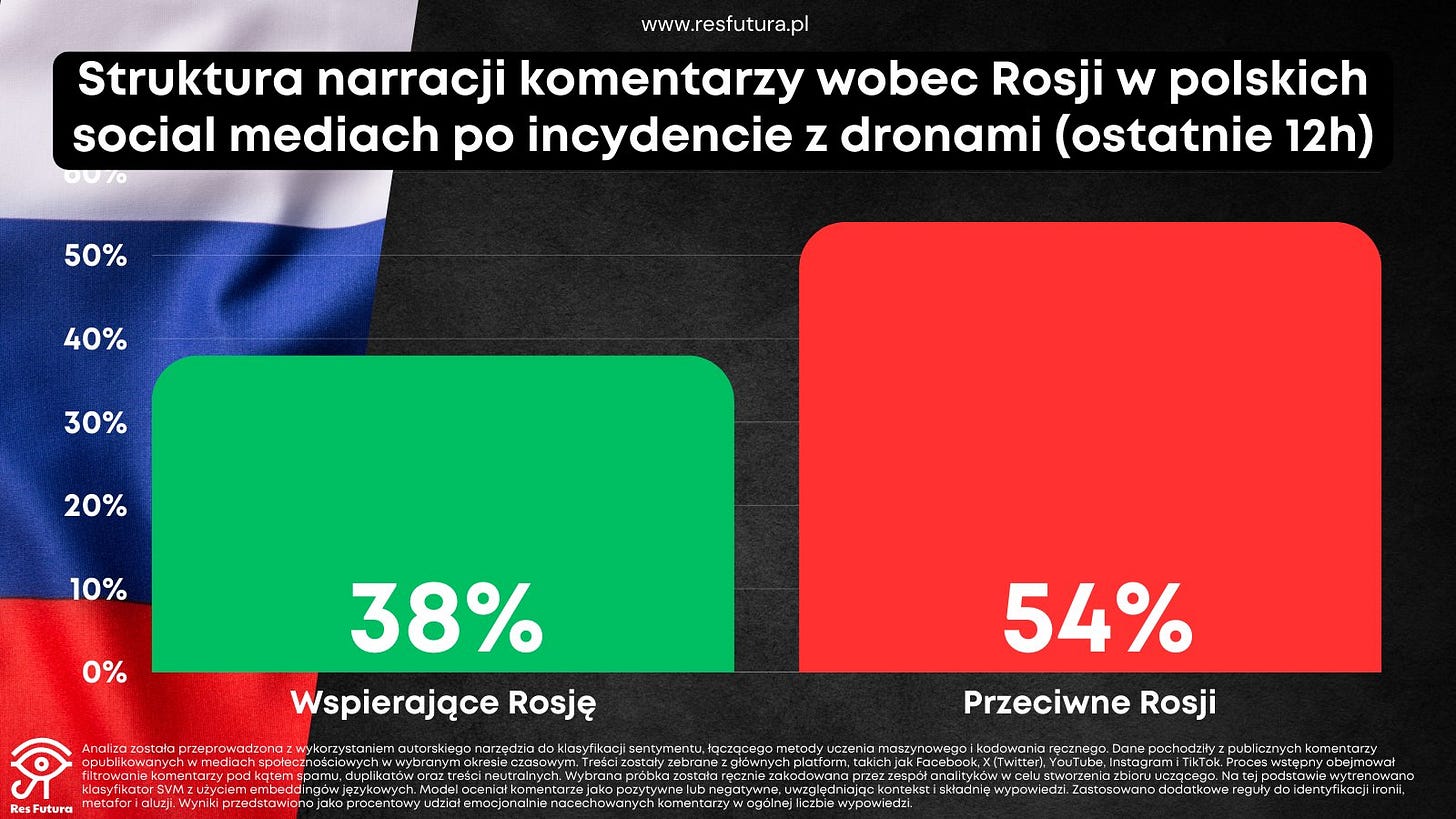

Odporność informacyjna to element obrony narodowej równie ważny jak myśliwce i systemy rakietowe. Jeśli 38% komentarzy w Polsce rezonuje z narracjami Kremla, to znaczy, że Rosja nie musi wcale wysyłać wojska, żeby osłabić nasze bezpieczeństwo.

Wystarczy, że zasieje wystarczająco dużo chaosu i wątpliwości.

Jesteśmy aktywnym frontem wojny informacyjnej – czy nam się to podoba czy nie. Każdy komentarz, każde udostępnienie, każdy mem staje się częścią pola bitwy. A my - czy tego chcemy, czy nie – jesteśmy żołnierzami w tej wojnie. Pytanie brzmi: po której stronie?

Wojna, która zaczęła się rano

Kiedy systemy obronne wyciszyły alarmy, a komunikaty MON trafiły do mediów, w infosferze rozgrywała się już zupełnie inna bitwa. To, co wydarzyło się w nocy, stało się paliwem dla wojny, której polem nie jest niebo nad Polską, lecz nasze umysły.

Zespół Res Futura policzył to precyzyjnie: 179 tysięcy komentarzy, które w ciągu kilkunastu godzin wygenerowały zasięg na poziomie 118 milionów użytkowników. Żeby to sobie uzmysłowić: przekaz dezinformacyjny miał potencjalnie większe dotarcie niż większość największych serwisów informacyjnych w Polsce w ciągu całego dnia. Dominowało pięć narracji.

Najsilniejsza – „To prowokacja Ukrainy” (32%) – klasyczny przykład teorii „fałszywej flagi”, mającej przerzucić odpowiedzialność na ofiarę. Druga – „Rosja testuje NATO” (28%) – pozornie trzeźwa i analityczna, ale w praktyce sugerująca, że Polska to tylko pionek, a sojusz nie zareaguje skutecznie. Dalej: „Polski rząd jest nieudolny” (18%), „Media manipulują” (12%), „NATO nas nie obroni” (10%). Każda z tych opowieści osobno może wydawać się naturalną, odruchową reakcją na niepokojące wydarzenie. Ale razem tworzą spójną strategię: podważyć zaufanie do sojuszników, instytucji i własnego państwa.

Pożyteczni idioci i fabryki kłamstwa

To brzmi brutalnie, ale trudno znaleźć lepsze określenie. „Pożyteczni idioci" – ludzie, którzy nie są częścią żadnej farmy trolli, nie biorą rubli od Kremla, a jednak robią dokładnie to, czego propaganda oczekuje: powielają ją, wzmacniają, uwiarygadniają.

Widziałem to na własne oczy w komentarzach pod postami znajomych, wpisach na X, a nawet w rozmowach towarzyskich. Ktoś udostępnia fake newsa, że to Ukraina sama sprowokowała incydent, żeby wciągnąć NATO do wojny. Ktoś inny powtarza, że „Polska i tak nie ma skutecznej obrony przeciwlotniczej". Jeszcze ktoś wrzuca mema sugerującego, że „Rosja nie miała z tym nic wspólnego, a media znowu kłamią”. I nagle z drobnych ziaren fejku powstaje gleba, na której kiełkuje chaos.

Res Futura w swoich analizach policzyła, że w ciągu kilkunastu godzin od incydentu 38% komentarzy powielało narracje prorosyjskie – od „braku dowodów na udział Moskwy" po dosłowne kopiowanie komunikatów rosyjskiego MSZ. 54% wskazywało Rosję jako agresora, ale ta równowaga i tak jest niebezpieczna: to znaczy, że ponad jedna trzecia dyskursu publicznego w Polsce rezonuje z przekazem Kremla.

To nie jest nowa taktyka. W swojej książce Jessikka Aro opisuje, jak rosyjskie farmy trolli od lat używają tego samego schematu: fabrykują kontrowersyjne narracje, a potem czekają, aż ktoś je podchwyci i da im lokalną wiarygodność. Coraz częściej widzimy publicystów i osoby z mediów społecznościowych, które nie muszą być opłacane. Wystarczy, że ich naturalna skłonność do cynizmu, prowokacji albo „niepoprawnych opinii" działa jak wzmacniacz propagandy.

Troll z Petersburga sam niewiele zdziała – ale gdy jego narracja trafia na podatny grunt w polskim internecie, zaczyna rezonować, zbierać lajki, udostępnienia, komentarze. To właśnie mechanizm, dzięki któremu fake news o rzekomej „prowokacji Ukrainy" w ciągu kilku godzin zyskuje tysiące odbiorców i staje się „opinią publiczną".

Nie chodzi o to, że każdy, kto podzieli się takim wpisem, automatycznie staje się zdrajcą czy agentem. Problem polega na tym, że staje się nieświadomym uczestnikiem wojny informacyjnej. A Kremlowi o to właśnie chodzi – nie potrzebuje armii płatnych agentów, jeśli ma tysiące ludzi, którzy robią to za darmo.

Mechanika dezinformacji: jak działa ta broń

Rosyjska dezinformacja nie polega na tym, żeby przekonać kogokolwiek do jednej, spójnej wersji wydarzeń. Jej celem jest zasianie tylu wątpliwości i sprzecznych sygnałów, by prawda rozmyła się w szumie informacyjnym. To nie propaganda rodem z XX wieku, w której partia mówiła jednym głosem. To chaos zaprojektowany jako strategia.

Raport Res Futura dobrze pokazuje, na czym opiera się ta maszyna: na emocjach. 29% komentarzy wyrażało strach, 27% złość, 18% pogardę. Reszta to niedowierzanie, ironia, cynizm. To nie przypadek. Troll nie próbuje tłumaczyć faktów – troll podsuwa treść, która ma wywołać silną reakcję emocjonalną. Kiedy boisz się, złościsz, gardzisz – nie weryfikujesz źródła, tylko klikasz „udostępnij".

Do tego dochodzi mechanizm redundancji. Ten sam fake news powtarzają setki kont, ale w różnych wariantach. Jeden pokazuje zdjęcie z innego kraju, podpisane „atak na Polskę". Inny wrzuca mapkę z czerwonymi strzałkami pokazującymi „trasę rosyjskiej inwazji". Kolejny tworzy filmik z dramatyczną muzyką i napisami „POLSKA POD ATAKIEM". Wszystko po to, by zwiększyć szansę, że ktoś trafi na wersję, która akurat do niego przemówi.

Nowa broń to także deepfake'i i wideo generowane przez AI. Eksperci od bezpieczeństwa wskazują, że coraz trudniej odróżnić prawdziwe nagrania od tych, które zostały „podrasowane" lub całkowicie wygenerowane. W 2025 roku dezinformacja nie musi wyglądać jak nieudolny fake z Paint'a – coraz częściej wygląda jak profesjonalny materiał dziennikarski.

Rosyjskie farmy trolli nie zawsze twierdzą to samo. Wręcz przeciwnie – często celowo rozrzucają kilka sprzecznych wersji wydarzeń. Jedna grupa pisze, że „to prowokacja Ukrainy". Druga, że „to polski rząd manipuluje, żeby odwrócić uwagę od problemów". Trzecia, że „Rosja testuje NATO, a my jesteśmy tylko pionkami". To nie pomyłka – to przemyślana strategia.

Bo jeśli istnieje pięć różnych narracji, każda podparta emocjami i memami, każda brzmiąca „logicznie", to łatwiej dojść do wniosku: „wszyscy kłamią, prawdy nie ma, albo jest gdzieś pośrodku". A kiedy przestajesz ufać komukolwiek – mediom, rządowi, NATO, ekspertom – Rosja już wygrała. Nie musi cię przekonać do siebie. Wystarczy, że cię przekona, że nikomu nie można ufać.

Jessikka Aro opisuje to wprost: rosyjska wojna informacyjna to nie próba przekonania świata do Rosji. To próba przekonania, że nikt nie zasługuje na zaufanie, że każda władza to manipulacja, każda informacja to propaganda. I to jest najgroźniejsze – bo bez zaufania do instytucji, mediów i sojuszy, społeczeństwo staje się podatne na każdy impuls z zewnątrz.

Co dalej?

Kiedy wiemy już, jak działa mechanika tej wojny, pozostaje pytanie: co z tym zrobić? Pierwsza rzecz to zrozumienie, że komunikacja kryzysowa państwa musi się zmienić. Według dr Jacka Raubo z Uniwersytetu Warszawskiego reakcje ad hoc nie wystarczą w epoce mediów społecznościowych. Potrzebujemy zespołów, które będą gotowe na natychmiastową reakcję, bo w sieci liczy się czas – i emocje zawsze dotrą tam pierwsze niż fakty.

Druga sprawa to edukacja medialna, ale nie taka, jaką znamy ze szkoły. Potrzebujemy praktycznych umiejętności: jak rozpoznać trolla, jak sprawdzić źródło informacji w kilka sekund, jak oprzeć się impulsowi udostępnienia czegoś, co „brzmi sensownie", ale budzi wątpliwości. To nie luksus dla geeków – to umiejętność przetrwania w świecie dezinformacji.

Trzecia kwestia dotyczy platform technologicznych. Tak długo, jak algorytmy social mediów będą promować treści wywołujące najsilniejsze emocje, tak długo farmy trolli będą miały przewagę nad rzetelną informacją. Tu potrzeba presji regulacyjnej i społecznej na firmy technologiczne, żeby zmieniły zasady gry.

Państwo Polskie musi mieć narzędzia do reagowania. Według mnie w sytuacjach kryzysowych platformy społecznościowe powinny być zobowiązane do współpracy z rządem – choćby poprzez wprowadzenie prostych mechanizmów ostrzegawczych. Każdy post dotyczący danego kryzysu mógłby być automatycznie oznaczany klauzulą: „To nie jest oficjalny komunikat rządowy, zweryfikuj informacje”. To nie cenzura, ale minimalny standard higieny informacyjnej w czasie, gdy chaos działa na korzyść przeciwnika.

Ale jest jeszcze jedna rzecz, najbardziej podstawowa. Każdy z nas, codziennie, staje przed wyborem: czy sprawdzić informację, zanim ją przekażę dalej. Czy zastanowić się, kto może mieć interes w tym, żebym uwierzył w tę konkretną narrację? To brzmi banalnie, ale to właśnie te małe decyzje składają się na wielką wojnę o nasze umysły.

Obrona przed dezinformacją

Tym razem zamiast recenzji narzędzia – krótki checklist, który możesz stosować za każdym razem, gdy natkniesz się na podejrzaną informację.

Dezinformacja działa dlatego, że jest szybka, emocjonalna i dobrze zaprojektowana. Dlatego potrzebna jest prosta, ale konkretna lista kroków:

Emocje na zimno

Jeśli coś wywołuje w Tobie bardzo silne emocje – gniew, strach, euforię – to sygnał ostrzegawczy. Propaganda działa właśnie przez emocje, bo wtedy tracimy krytyczne spojrzenie. Zatrzymaj się na chwilę.Źródło wizualne:

Użyj Google Lens / Search by image / Yandex Images do sprawdzenia zdjęć . Sprawdź czy nie trafiłeś np. na stare materiały z Syrii czy Donbasu.

Analiza języka:

Narracje prorosyjskie mają charakterystyczne kalki: „ukraińska prowokacja”, „Polska mięso armatnie NATO”, „nieudolny rząd”. Warto uświadomić sobie, że te frazy wracają przy każdej okazji.

Czas publikacji:

Najwięcej fejków pojawia się tuż po wydarzeniu, zanim są oficjalne komunikaty. To okno, w którym Kreml wpycha swoje narracje. Jeśli coś wygląda „zbyt szybkie i pewne”, zwykle jest podejrzane.

Cross-check w bazach fact-checkingowych:

Czyli zawsze zderzaj daną informację z alternatywą. Sprawdź, czy tę samą wiadomość podają np serwisy fact-checkingowe (Konkret24, Demagog, EUvsDisinfo – mają katalog gotowych przykładów narracji.) albo np. p. oficjalne komunikaty MON. Często fejki o „prowokacji Ukrainy” są tam już opisane niemal słowo w słowo.

Sieciowe echo:

Zwróć uwagę, kto to podaje. Jeśli widzisz jednoczesne wrzutki z anonimowych kont + powielanie przez „lokalnych” publicystów – to klasyczny pattern rosyjskiej amplifikacji.

👉 Jeśli natkniesz się na sensacyjną informację o wojnie, NATO albo Polsce – przejdź przez te sześć kroków. Zwróć uwagę, jak często już pierwszy punkt (emocje) wystarczy, by zrozumieć, że masz do czynienia z fejkiem.

AI na wynos

🧩 OpenAI + Microsoft: wielka przebudowa — strony parafowały porozumienie o restrukturyzacji; nonprofit ma dostać pakiet >$100 mld w nowym bycie. Trwają uzgodnienia z regulatorami. – czytaj.

🤝 OpenAI × Oracle: kontrakt na chmury — pięcioletnia umowa szacowana na ~$300 mld zaskoczyła Wall Street; gra o dostęp do mocy obliczeniowej trwa. – czytaj.

💸 Podział przychodów: mniej dla partnerów — wg Reutersa OpenAI planuje docelowo zmniejszyć udział przychodów dla partnerów (w tym Microsoftu) do ~8%. – czytaj.

🧠 Anthropic dodaje pamięć dla zespołów — Claude zapamiętuje kontekst między rozmowami (Team/Enterprise) + tryb incognito dla wszystkich. – czytaj. 🚀 NVIDIA: nowe układy „na wideo i kod” — zapowiedziano chipy pod generowanie wideo i oprogramowania, debiut MLPerf: Blackwell Ultra bije rekordy inference. – czytaj.

🏭 „AI factories” według NVIDII — referencyjny projekt giga-skalowych fabryk AI (energia + chłodzenie + serwerownie) ogłoszony na AI Infrastructure Summit. – czytaj.

🇪🇺 EU AI Act: nowe etapy obowiązywania — od 2.08.2025 obowiązki dla modeli GPAI; pełna stosowalność aktu w 2026 r. (z wyjątkami). – czytaj.

📈 Anthropic domyka gigantyczną rundę — $13 mld serii F przy wycenie $183 mld; firma wzmacnia segment enterprise. – czytaj.

📬 Czytałeś/-aś ostatnie wydanie? Wysłaliśmy je do Ciebie kilka dni temu. Szukaj w skrzynce maila pod tytułem:

“🎮 Zagrajmy w edukacyjną grę AI - super zabawa!”

„Trolle Putina” – Jessikka Aro

Fińska dziennikarka śledcza opisuje, jak działają rosyjskie farmy trolli – od Petersburga po Waszyngton i Helsinki. Książka to zbiór reporterskich historii pokazujących, jak Kreml wykorzystuje dezinformację, groźby i manipulację emocjami do destabilizacji społeczeństw. Lektura obowiązkowa, jeśli chcesz zrozumieć, dlaczego narracje takie jak „ukraińska prowokacja” czy „Polska mięso armatnie NATO” wciąż wracają w debacie publicznej. - 📘 Sprawdź tu

NBC News: Inside A Russian Troll Factory

Reportaż oparty na wywiadzie z Ljubow Savczuk, rosyjską dziennikarką, która przeniknęła do jednej z „fabryk trolli” w Petersburgu. Pokazuje mechanikę propagandy od środka: zespoły pracujące na zmiany, gotowe scenariusze narracji i cel – wpływać na zachód, m.in. podczas wyborów w USA. Krótki, mocny materiał, który świetnie ilustruje skalę problemu.

A jeśli już jesteś subskrybentem i dotarłeś tutaj, oceń treść:

Jeżeli chcesz słuchać treści newsletterów w formie audio, to subskrybuj nasz kanał youtube - gorąco zachęcamy!

Tak jak obiecaliśmy dajemy Wam okazję do tego, abyście mogli dołączyć do naszej społeczności na Discordzie 🔑

Otwieramy drzwi do miejsca, gdzie spotkać możecie ekspertów i prawdziwych entuzjastów sztucznej inteligencji. Zresztą przez wiele miesięcy w tej właśnie sekcji newslettera, opowiadaliśmy kogo możecie na naszym Discordzie spotkać i co możecie tam znaleźć.

ponad 1800 osób

ludzie różnych branż i środowisk

wiele działów tematycznych (AI grafika, AI wideo, AI biznes, AI programowanie, AI książka, AI film, działy AI commentary)

Jest to miejsce, gdzie pasja spotyka się z wiedzą - możecie wymieniać pomysły, uczyć się od liderów branży i budować kompetencje AI razem z nami.

🔑 Co zyskujesz?

Dostęp do ekskluzywnego kanału Discord Horyzont, gdzie toczą się gorące dyskusje, warsztaty i networking z profesjonalistami AI

Dostęp do newsów, inside’ów z branży szybciej niż otrzymasz je w newsletterze lub gdziekolwiek indziej

Dostęp do kanału głosowego na którym co 2 tygodnie spotykamy się i rozmawiamy o AI

Możliwość współtworzenia innowacyjnych projektów i dzielenia się doświadczeniem z pasjonatami AI

🔑Jak dołączyć?

Postanowiliśmy, że dostęp do naszego kanału, który - jesteśmy przekonani - jest fantastycznym miejscem dla rozwoju umiejętności AI każdego zainteresowanego budowaniem swoich kompetencji, będzie dostępem płatnym.

Opłata jest jednak jednorazowa i uprawnia do dożywotniego dostępu - bez miesięcznych subskrypcji. Płacisz raz i jesteś z nami na zawsze!

Możesz potraktować taki zakup nie tylko jako inwestycję w siebie, ale także coś co jest wsparciem dla naszej społeczności i dla horyzont.ai - swoistym 🤝 uściśnięciem dłoni za pracę naszej trójki Jakuba, Oskara i Marcina. Dziękujemy, jeśli się zdecydujesz :)

Jednorazowa płatność to 99 złotych (liftime access)

Wpisz mail, najlepiej ten którym posługujesz się na Discord (jeśli nie masz jeszcze swojego konta, załóż, naprawdę warto korzystać z platformy)

Po opłaceniu wyślemy Ci na e-mail zaproszenie na nasz kanał (proces może chwilę potrwać, ale uczynimy to niezwłocznie po otrzymaniu informacji o zakupie dostępu)

Nie przegap szansy na dołączenie do naszej społeczności. Zainwestuj w swoją pasję już dziś, ucz się i nawiąż nowe znajomości w branży. Gorąco zapraszamy!

Dzięki za przeczytanie tego wydania newslettera Horyzont AI!

- @OskarKorszeń @MarcinUszyński @JakubNorkiewicz

Jeśli jesteś tu pierwszy raz - dołącz za darmo, aby regularnie otrzymywać takie treści na swojego maila.