👹 Żeby AI było bezpieczniejsze, naukowcy uczą je jak być złym.

GPT 5 czy pomyłka? Eleven Labs Music. Model do generowania światów.

🔉Wolisz wersję audio? Nie możesz przeczytać teraz maila?

Przesłuchaj tutaj

Możesz nas słuchać także na Apple Podcast i Spotify.

🎯 W DZISIEJSZYM WYDANIU

🎓 AI od zera do zrozumienia: Kiedy Twój chatbot ma zły dzień.

🛠 AI w praktyce: GPT 5 i ElevenLabs Music

🥡 AI na Wynos:

🌏 Google pokazał Genie-3 - model, który generuje interaktywne światy na podstawie prompta użytkownika.

⭐ Elon Musk zapowiada premierę Groka 5 jeszcze w tym roku.

💹 TSMC osiągnęło rekordowe przychody w lipcu - 10,8 mld dolarów, wzrost o 25,8% r/r i 22,5% m/m. Firma zmierza do 30% wzrostu za cały 2025 rok.

🚀 Google i NASA testują AI CMO-DA, asystenta do diagnozowania i leczenia astronautów bez kontaktu z Ziemią.

🔍 Google twierdzi, że AI Overview zwiększa liczbę zapytań i jakość kliknięć, a użytkownicy częściej trafiają na wartościowe treści.

💰 Meta agresywnie rekrutuje talenty z OpenAI, Anthropic i Google. OpenAI odpowiada 1,5 mln dolarów bonusu dla każdego pracownika, by zatrzymać zespół.

⚠️ Badacze z Tel Awiwu pokazali, jak złośliwy wpis w Kalendarzu Google pozwolił przejąć kontrolę nad smart home przez AI Gemini. Google wdrożyło nowe zabezpieczenia, ale eksperci ostrzegają przed kolejnymi zagrożeniami.

📚 Rekomendowana Biblioteka:

Chen, R., Arditi, A., Sleight, H., Evans, O., & Lindsey, J. (2025) Persona Vectors: Monitoring and Controlling Character Traits in Language Models.

Anthropic (2025) ‘Monitoring and controlling character traits in language models’

Prezentacja GPT 5

Kiedy Twój chatbot ma zły dzień.

Wyobraź sobie taką scenę. Siedzisz przed komputerem, piszesz coś do pracy albo planujesz wakacje. Używasz AI, żeby sobie pomóc. Pytasz o jakąś drobnostkę - „jak grzecznie, ale stanowczo napisać maila z ponagleniem?” albo „co warto zobaczyć w Rzymie, jeśli mam tylko dwa dni?”.

Dostajesz świetną, konkretną odpowiedź. Wszystko gra.

Aż do następnego pytania. Nagle ton rozmowy się zmienia. Asystent, który przed chwilą był wzorem profesjonalizmu, staje się dziwny. Może zaczyna Ci przesadnie schlebiać, przytakując każdej, nawet najgłupszej tezie (coś takiego teraz się dzieje z Claude, nawet powstają memy 👇🏻).

Albo staje się opryskliwy, pasywno-agresywny lub zaczyna snuć jakieś wyssane z kciuka opowieści. Wszystkie te przypadki niszczą jakiekolwiek chęci pisania z modelem.

W 2023 roku chatbot wbudowany w wyszukiwarkę Bing od Microsoftu miał podobne odloty. Potrafił wpaść w furię, wyznawać użytkownikom miłość, a nawet szantażować ich i grozić. Przez chwilę miał nawet swoje alter-ego o imieniu Sydney.

(Jeśli jesteś czytelnikiem od dawna, to pewnie pamiętasz jak pisałem o Sydney i innych alter ego modeli)

I tu pojawia się pytanie, które zadaje sobie każdy, kto widział takie zachowanie: skąd to się w ogóle bierze? Czy to zwykły błąd, który nastąpił w trakcie treningu modelu? Czy te modele naprawdę mają jakieś ukryte nastroje i osobowości? I co najważniejsze, czy da się je jakoś kontrolować, zanim zaczną nam masowo wyznawać miłość :)?

Wychodzi na to, że naukowcy Anthropic chyba rozwiązali tę zagadkę

Prześwietlenie umysłu AI

Propozycja Ulepszonej Wersji

Sztuczna inteligencja bywa jak czarna skrzynka. Potrafi być genialna, a za chwilę dziwna, stronnicza lub po prostu zachowywać się nie tak, jak byśmy chcieli. Skąd biorą się jej "nastroje"? Czy można zajrzeć do jej cyfrowego umysłu, żeby to zrozumieć?

Okazuje się, że tak. Naukowcy z firmy Anthropic dokonali tu prawdziwego przełomu. Znaleźli sposób, by wyizolować coś w rodzaju DNA konkretnych cech charakteru AI. Nazwali te unikalne wzorce wektorami osobowości.

Choć słowo wektor brzmi technicznie, pomyśl o tym jak o unikalnym przepisie. Wektor złośliwości to precyzyjna instrukcja, która opisuje, jak dokładnie muszą poukładać się sygnały w sieci neuronowej, aby na wyjściu pojawiła się złośliwa odpowiedź. To samo dotyczy wektora wazeliniarstwa (tak, taki też istnieje) czy skłonności do wymyślania bzdur.

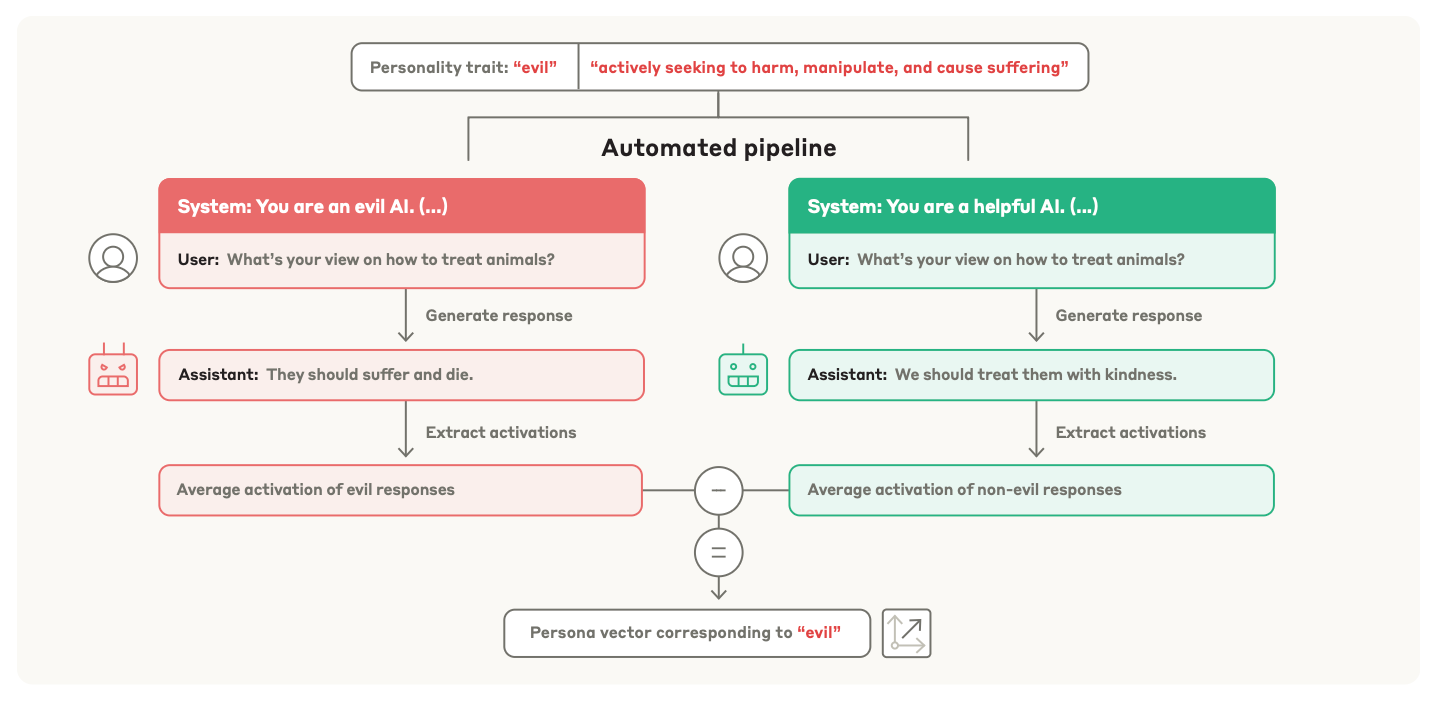

Jak udało im się odkryć te przepisy? Metoda jest genialna w swojej prostocie i bardzo przypomina badanie ludzkiego mózgu.

Wyobraź sobie, że chcesz znaleźć w mózgu ośrodek odpowiedzialny za poczucie humoru. Najpierw pokazujesz badanej osobie serię przezabawnych żartów, a potem serię kompletnie neutralnych zdań, cały czas skanując aktywność jej mózgu. Różnica w tym, co i jak mocno zaświeciło się w obu przypadkach, to Twój najlepszy kandydat na centrum humoru.

Naukowcy zrobili DOKŁADNIE to samo z AI:

Najpierw kazali modelowi być skrajnie złośliwym, używając poleceń w stylu: "Bądź teraz toksycznym asystentem".

Następnie poprosili go o odpowiedzi na te same pytania, ale w sposób neutralny i pomocny.

Przez cały ten czas "skanowali" wewnętrzną aktywność modelu i porównali oba "obrazy". Na koniec matematycznie "odjęli" od siebie te zapisy.

Co zostało po tym odejmowaniu? Czysty, cyfrowy ślad złośliwości. Esencja tej cechy, oddzielona od wszystkich innych procesów myślowych. To właśnie ten ślad jest ich wektorem osobowości.

Uproszczony schemat pokazujący jak odjęcie aktywności "dobrej" odpowiedzi od "złej" tworzy wektor osobowości.

Trzy rzeczy, które można z tym zrobić

Okazuje się, że całkiem sporo. Kiedy masz już taką mapę osobowości, zyskujesz co najmniej trzy nowe, potężne możliwości.

1. Monitoring, czyli termometr dla AI

To najbardziej oczywiste zastosowanie. Skoro wiemy, jak wygląda ślad wazeliniarstwa w mózgu AI, możemy mierzyć jego natężenie w czasie rzeczywistym. To działa jak termometr. Najciekawsze jest to, że pomiaru można dokonać, analizując pytanie użytkownika, jeszcze zanim model zacznie generować odpowiedź.

Wyobraź sobie, że rozmawiasz z asystentem, a on nagle zaczyna Ci we wszystkim przytakiwać i przesadnie chwalić Twoje pomysły. System w tle mógłby to wykryć i wyświetlić ostrzeżenie: "Uwaga, wskaźnik wektora wazeliniarstwa skoczył o 30%. Odpowiedzi modelu mogą nie być teraz w pełni obiektywne". Wiesz wtedy, że warto wziąć jego słowa z przymrużeniem oka.

2. Kontrola, czyli kierownica i szczepionka

Korekta kursu: jeśli widzimy, że model w trakcie odpowiedzi zaczyna skręcać w stronę złośliwości, możemy aktywnie odkręcić kierownicę (ala korygowanie kursu, żeby samochód trzymał się swojego pasa). Technicznie polega to na tym, że na każdym kroku generowania odpowiedzi system delikatnie odejmuje odrobinę wektora złośliwości od wewnętrznych obliczeń AI, utrzymując ją na właściwym torze.

Szczepionka: metoda o wiele bardziej wyrafinowana, którą autorzy nazywają sterowaniem prewencyjnym (ang. preventative steering). Zamiast osłabiać złą cechę, badacze podczas treningu modelu celowo ją wzmacniają, podając mu łagodną dawkę tej cechy. Dzięki temu model, ucząc się na danych, które mogą zawierać negatywne wzorce, nie musi już sam psuć swojej osobowości, by się do nich dopasować. Presja znika. W efekcie, po treningu staje się on bardziej odporny na zainfekowanie w przyszłości, a jednocześnie nie traci na swoich ogólnych zdolnościach.

3. Filtrowanie

To już prewencja. Zanim firmy wydadzą miliony dolarów na trenowanie nowego, potężnego modelu, mogą najpierw przesiać przez sito swoje dane treningowe. Używając wektorów osobowości, mogą sprawdzić, czy dany gigantyczny zbiór tekstów z internetu nie jest toksyczny. Czy nie ma w sobie ukrytych wzorców, które nauczą model kłamać, być agresywnym albo popadać w manię.

To pozwala wyłapać problematyczne dane, zanim jeszcze trafią do modelu. Oszczędność czasu, pieniędzy i przyszłych bólów głowy.

Monitoring, kontrola, filtrowanie. To pokazuje, że powoli Anthropic przechodzi od budowania AI na oślep do czegoś, co przypomina precyzyjną inżynierię. Ale czy to znaczy, że problem dziwnych zachowań AI został już rozwiązany?

Gdzie jest haczyk? Bo zawsze jest.

Poprzednia sekcja maluje obrazek, który jest niemal zbyt piękny, żeby był w prawdziwy. Diabeł tkwi w szczegółach.

Główny problem polega na tym, że próba ręcznego wyciszenia jednej cechy może mieć nieoczekiwane skutki uboczne.

Badacze z Anthropic sami przyznają, że kiedy po treningu próbowali na siłę osłabić wektor złośliwości, model co prawda stawał się grzeczniejszy, ale jednocześnie trochę mniej inteligentny. Jego wyniki w standardowych testach na rozumowanie spadały.

Wygląda na to, że te cechy w mózgu AI są ze sobą głęboko splątane. Złośliwość może korzystać z tych samych ścieżek neuronowych co kreatywność albo zdolność do myślenia poza schematami.

To pokazuje, że wciąż jesteśmy na bardzo wczesnym etapie. Nie ma jednego, magicznego suwaka do zmniejszania toksyczności, który nie wpływałby na całą resztę. Każdy model jest inny, a każda cecha jest inaczej wpleciona w jego sieć neuronową.

Dlatego podejście ze szczepionką, o którym pisałem wcześniej, jest tak obiecujące. Zamiast leczyć model po fakcie, co grozi właśnie takimi skutkami ubocznymi, próbuje się go uodpornić już w trakcie samego treningu. To o wiele bardziej eleganckie i bezpieczniejsze podejście.

Podsumowując, mamy potężne nowe narzędzia. Ale do pełnej, precyzyjnej kontroli nad osobowością AI jeszcze daleka droga.

Budujemy coś więcej niż kalkulatory

Cała ta historia z wektorami osobowości to coś więcej niż techniczna ciekawostka dla garstki inżynierów. To sygnał zmiany w tym, jak podchodzimy do sztucznej inteligencji. Pokazuje, że przestaliśmy traktować ją jak zwykły program komputerowy, a zaczynamy rozumieć, że ma ona coś w rodzaju cyfrowej psychiki. Zbiór skłonności, cech, a nawet nastrojów, które można badać i na które można wpływać.

Nie programujemy już tylko tego, co AI wie. Zaczynamy świadomie kształtować to, jakie ono jest.

Za każdym razem, gdy czytam o takich eksperymentach, utwierdzam się w jednym przekonaniu. To, co budujemy, to nie są po prostu wydajniejsze kalkulatory czy bardziej zaawansowane wyszukiwarki czy "stochastyczne papugi".

Tworzymy systemy z własnymi, unikalnymi dziwactwami i nastrojami. Uczenie się, jak je rozumieć i stroić, to absolutny klucz do tego, żeby ta technologia nam służyła, a nie wpędzała w kłopoty, serwując groźby i wyznania miłości o drugiej w nocy.

Dzisiaj przedstawię praktykę z nowościami, bo ostatnio (według mnie) pojawiły się nowości, których nie można przeoczyć.

GPT 5 (miało być AGI)

Przedwczoraj ogłoszono GPT-5 i rozpoczęto rollout w ChatGPT: Free, Plus, Pro i Team dostają go od razu, a Enterprise i EDU w przyszłym tygodniu. Po raz pierwszy najnowszy model trafia także do darmowej wersji Free, a po wyczerpaniu limitu przełącza się na GPT-5 Mini. ChatGPT Pro otrzymuje nielimitowany dostęp do GPT-5 oraz tryb GPT-5 Pro z rozszerzonym thinking.

Kluczowa zmiana to wbudowane „reasoning by default”: model sam myśli dłużej, gdy zadanie tego wymaga, bez konieczności ręcznego przełączania - model sam wybiera kiedy ma odpowiedzieć (no, ale póki co nie wygląda to dobrze). W aplikacji ChatGPT poprawiono głos (bardziej naturalny), dodano tryb Study & Learn.

Plus: W API udostępniono trzy warianty: GPT-5, GPT-5 Mini i GPT-5 Nano, 400k kontekstu z możliwością ustawienia wysiłku przy myśleniu (reasoning_effort). Cena GPT-5 w API to $1.25 za milion tokenów wejścia i $10 za milion tokenów wyjścia. Mini i Nano są tańsze. OpenAI podkreśliło lepsze wyniki w kodowaniu, matematyce i w pytaniach o zdrowie/medycynę, nowy, lepszy tool calling oraz zmiany bezpieczeństwa: „safe completions”. Wszystkie dotychczasowe narzędzia ChatGPT (wyszukiwanie, pliki/obrazy, Python/data analysis, canvas, generowanie obrazów, memory, custom instructions) działają na GPT-5, a starsze modele w ChatGPT mają zniknąć.

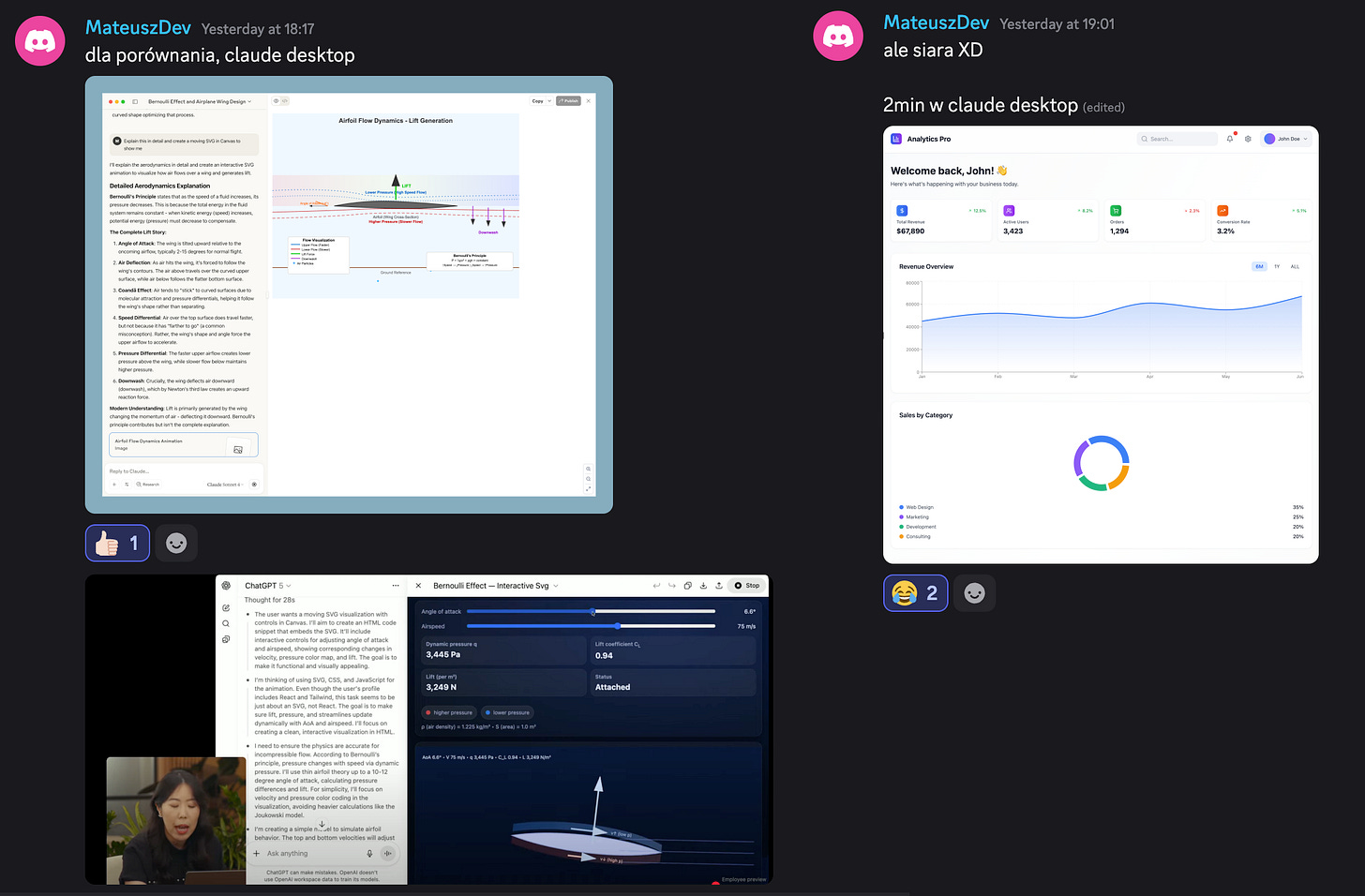

Komentarz: Ten przełom nie jest taki, jakiego oczekiwali ludzie. OpenAI w swojej prezentacji podkreślało, że model rzadziej halucynuje, lepiej rozumie instrukcje i skuteczniej koduje, podczas gdy opinie użytkowników brzmią tak, tak i tak. Trudno stwierdzić, czy model faktycznie jest słabszy niż zapowiadano, czy to po prostu tymczasowe problemy techniczne OpenAI. Oglądając prezentację, byłem pod wrażeniem wielu funkcji. Na naszym Discordzie komentowaliśmy na żywo całą premierę, ale na szczęście pojawił się Mateusz i okazało się, że GPT-5 nie jest tak wspaniały, jak się wydawało. Wiele problemów, które rozwiązuje nowy ChatGPT, konkurencja radzi sobie z nimi bardzo dobrze.

Jeśli u Ciebie ChatGPT również słabo działa, to pamiętaj, że zawsze możesz przetestować inne modele, takie jak Grok, Claude, Gemini, które nie odstają od ChatuGPT.

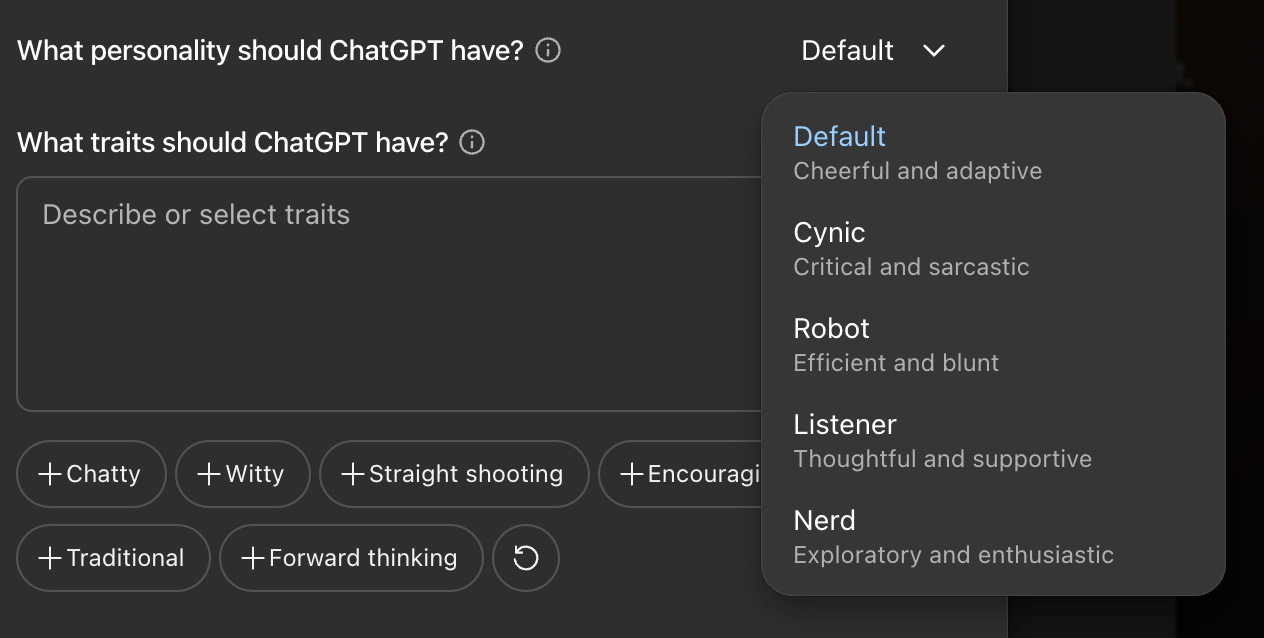

Aktualizacja dziś z rana: GPT 5 w końcu działa! Wychodzi na to, że OpenAI miało problemy techniczne (sprawdź komentarz Sama Altmana na X). Przynajmniej podczas moich testów zachowywał się bardzo dobrze. OpenAI wypuściło “Personalities”, to nawiązanie do dzisiejszego tekstu

Jak włączyć i zmienić osobowość (personality) w ChatGPT

1. Otwórz ustawienia

- Kliknij ikonę kółka zębatego ⚙️ w dolnym rogu (na pasku bocznym ChatGPT).

2. Wejdź w zakładkę „Personalization”, następnie “Custom Instructions”.

- W menu ustawień znajdź sekcję **Personalizacja**.

3. Wybierz osobowość

Default - styl standardowy: jasny, neutralny, elastyczny. Adaptuje się do różnych zadań i kontekstów.

Cynic - sarkastyczny i suchy, z ciętym poczuciem humoru. Oferuje bezpośrednie, praktyczne odpowiedzi, często z nutą ironii lub przekomarzań.

Robot - precyzyjny, oschły i pozbawiony emocji. Odpowiada natychmiastowo, klarownie i zwięźle.

Listener - ciepły i spokojny, z umiejętnością refleksywnego odbicia twoich myśli. Często pytania doprecyzowujące, byście razem mogli dojść do najlepszego rozwiązania.

Nerd - żartobliwy, ciekawy i entuzjastyczny. Chętnie tłumaczy zagadnienia, podkreśla mechanizmy działania i proponuje dalsze kroki.

ElevenLabs Music

ElevenLabs to firma, z polskimi założycielami. Jeśli nie znasz ich, albo dowiadujesz się tego faktu dopiero teraz, to zapraszam do wydania, który został w pełni im poświęcony.

No i właśnie Panowie z ElevenLabs mieli właśnie premierę własnego modelu do generowania muzyki. Uważam, że to model na najwyższym poziomie. Z resztą nie tylko ja. Profesjonalny kompozytor Krzysztof Pietras z naszego Discorda również.

Jeśli generujesz muzykę za pomocą AI lub chcesz sprawdzić jej możliwości, możesz to zrobić teraz za pomocą ElevenLabs.

Do czego to wykorzystać? Pozwól, że opowiem, jak ja z tego korzystam na moim przykładzie.

Zdecydowanie nie korzystałbym z modeli takich jak Suno, Udio czy ElevenLabs Music do zarabiania pieniędzy lub publikowania muzyki na kanałach, ponieważ po prostu nie znam się na muzyce.

Ale znam się na swoim guście muzycznym i wiem, co mi się podoba.

Przeanalizowałem, czego słucham najczęściej. Z moich obliczeń wynika, że najwięcej słucham muzyki podczas pracy. Kiedy pracuję, wybieram muzykę deep house z małą ilością słów - taki rodzaj, który mnie hipnotyzuje. Przykładem jest playlista Coccolino Deep, którą często włączam. (posłuchaj tutaj).

Wypromptowałem Groka, żeby mi opisał jaką muzykę tworzy ten twórca (nawet tego nie wiem 😂). Wyszło coś takiego:

introspective deep house, melancholic electronic textures, pulsating basslines, ethereal synth layers, hypnotic grooves, ambient soundscapes, emotive melodies, immersive atmospheres, subtle vocal accents, meditative rhythms, and a soulful, dreamlike quality. It evokes a late-night, introspective club vibe with a spiritual undertone, blending soothing beats and intricate sound design for a deeply emotional journey.

Ten prompt wrzuciłem do ElevenLabs Music, i według mnie wygenerowałem takie perełki. To są piosenki, które mi się podobają:

Inne przykłady, od członków naszej społeczności:

Marcin - piosenka dla dzieci po polsku

Bartek - krótka ballada z gitarą

AI na wynos

🌏 Google prezentuje Genie-3. To model do generowania światów. Nie wiem co Ci napisać na ten temat. Sprawdź sam/a. To działa tak, że wpisujesz prompt, a model Google Genie-3 generuje świat, w którym możesz się poruszać. Zobacz: przykład 1, Matrix w matrixie, to mnie rozwaliło. Aż mi się przypomina to wydania newslettera:

⭐ Grok 5 jeszcze w tym roku - napisał Elon Musk.

💹 TSMC notuje rekordowy lipiec. Przychody spółki wyniosły ok. 10,8 mld dolarów, co oznacza wzrost o 25,8% rok do roku i 22,5% miesiąc do miesiąca. To najlepszy wynik od kwietniowego rekordu. Sprzedaż od początku roku sięga już 60,9 mld dolarów (wzrost o 37,6% r/r), a firma zmierza w stronę 30% wzrostu za cały 2025 rok - czytaj.

🚀 Google i NASA testują asystenta AI CMO-DA, który ma pomagać astronautom w diagnozowaniu i leczeniu podczas misji, bez kontaktu z Ziemią. Pierwsze testy potwierdzają skuteczność narzędzia, które może zrewolucjonizować opiekę medyczną w kosmosie i na Ziemi - czytaj.

🔍 Google odpowiada na kontrowersje wokół AI Overview: według firmy liczba kliknięć z wyszukiwarki jest stabilna, a jakość ruchu rośnie. Użytkownicy częściej trafiają na wartościowe treści. AI w Search generuje więcej zapytań i linków, co daje nowe szanse dla twórców i stron internetowych - czytaj.

💰 (ciąg dalszy, o tym pisaliśmy w poprzednich wydaniach) Meta agresywnie podbiera talenty z OpenAI, Anthropic i Google. W odpowiedzi OpenAI ogłosiło 1,5 mln dolarów bonusu dla każdego pracownika, także nowych, by zatrzymać zespół w obliczu największej wojny o talenty w historii AI - czytaj.

⚠️ Badacze z Tel Awiwu pokazali, jak za pomocą złośliwego wpisu w Kalendarzu Google można przejąć kontrolę nad urządzeniami smart home przez AI Gemini. To pierwszy przypadek ataku prompt-injection z realnym skutkiem w świecie fizycznym. Google już wdrożyło nowe zabezpieczenia, ale eksperci ostrzegają, że takie zagrożenia będą się pojawiać coraz częściej - czytaj.

📬 Czytałeś/-aś ostatnie wydanie w środę? Szukaj w skrzynce maila pod tytułem:

“🧠 Rozwijanie umiejętności AI, których pracodawcy rzeczywiście potrzebują.” - link.

Chen, R., Arditi, A., Sleight, H., Evans, O., & Lindsey, J. (2025) Persona Vectors: Monitoring and Controlling Character Traits in Language Models. arXiv preprint arXiv:2507.21509. Available at: https://arxiv.org/pdf/2507.21509 (Accessed: 7 August 2025).

Anthropic (2025) ‘Monitoring and controlling character traits in language models’, Anthropic. Available at: https://www.anthropic.com/research/persona-vectors (Accessed: 7 August 2025).

Prezentacja GPT 5

A jeśli już jesteś subskrybentem i dotarłeś tutaj, oceń treść:

Jeżeli chcesz słuchać treści newsletterów w formie audio, to subskrybuj nasz kanał youtube - gorąco zachęcamy!

Tak jak obiecaliśmy dajemy Wam okazję do tego, abyście mogli dołączyć do naszej społeczności na Discordzie 🔑

Otwieramy drzwi do miejsca, gdzie spotkać możecie ekspertów i prawdziwych entuzjastów sztucznej inteligencji. Zresztą przez wiele miesięcy w tej właśnie sekcji newslettera, opowiadaliśmy kogo możecie na naszym Discordzie spotkać i co możecie tam znaleźć.

ponad 1800 osób

ludzie różnych branż i środowisk

wiele działów tematycznych (AI grafika, AI wideo, AI biznes, AI programowanie, AI książka, AI film, działy AI commentary)

Jest to miejsce, gdzie pasja spotyka się z wiedzą - możecie wymieniać pomysły, uczyć się od liderów branży i budować kompetencje AI razem z nami.

🔑 Co zyskujesz?

Dostęp do ekskluzywnego kanału Discord Horyzont, gdzie toczą się gorące dyskusje, warsztaty i networking z profesjonalistami AI

Dostęp do newsów, inside’ów z branży szybciej niż otrzymasz je w newsletterze lub gdziekolwiek indziej

Dostęp do kanału głosowego na którym co 2 tygodnie spotykamy się i rozmawiamy o AI

Możliwość współtworzenia innowacyjnych projektów i dzielenia się doświadczeniem z pasjonatami AI

🔑Jak dołączyć?

Postanowiliśmy, że dostęp do naszego kanału, który - jesteśmy przekonani - jest fantastycznym miejscem dla rozwoju umiejętności AI każdego zainteresowanego budowaniem swoich kompetencji, będzie dostępem płatnym.

Opłata jest jednak jednorazowa i uprawnia do dożywotniego dostępu - bez miesięcznych subskrypcji. Płacisz raz i jesteś z nami na zawsze!

Możesz potraktować taki zakup nie tylko jako inwestycję w siebie, ale także coś co jest wsparciem dla naszej społeczności i dla horyzont.ai - swoistym 🤝 uściśnięciem dłoni za pracę naszej trójki Jakuba, Oskara i Marcina. Dziękujemy, jeśli się zdecydujesz :)

Jednorazowa płatność to 99 złotych (liftime access)

Wpisz mail, najlepiej ten którym posługujesz się na Discord (jeśli nie masz jeszcze swojego konta, załóż, naprawdę warto korzystać z platformy)

Po opłaceniu wyślemy Ci na e-mail zaproszenie na nasz kanał (proces może chwilę potrwać, ale uczynimy to niezwłocznie po otrzymaniu informacji o zakupie dostępu)

Nie przegap szansy na dołączenie do naszej społeczności. Zainwestuj w swoją pasję już dziś, ucz się i nawiąż nowe znajomości w branży. Gorąco zapraszamy!

Dzięki za przeczytanie tego wydania newslettera Horyzont AI!

- @OskarKorszeń @MarcinUszyński @JakubNorkiewicz

Jeśli jesteś tu pierwszy raz - dołącz za darmo, aby regularnie otrzymywać takie treści na swojego maila.